bazy RAG – klucz do skutecznego AI w biznesie

Czym jest RAG i dlaczego ma znaczenie dla AI w biznesie?

RAG (Retrieval-Augmented Generation) to podejście, w którym generatywny model językowy (LLM) jest wspomagany przez zewnętrzną bazę wiedzy podczas generowania odpowiedzi. Zamiast polegać wyłącznie na swojej statycznej wiedzy z treningu, model przed udzieleniem odpowiedzi wyszukuje aktualne, powiązane informacje w dedykowanej bazie danych lub dokumentach. Dzięki temu odpowiedzi AI stają się bardziej trafne, aktualne i osadzone w faktach, co ma ogromne znaczenie dla zastosowań biznesowych.

Tradycyjne duże modele językowe mają kilka ograniczeń – ich wiedza jest zamknięta w granicach danych treningowych (często nieświeżych), a gdy pytanie wykracza poza te dane, model może halucynować, czyli zmyślać odpowiedzi. W kontekście biznesu takie niepewne informacje są nieakceptowalne. RAG rozwiązuje ten problem, bo każda odpowiedź jest “uzupełniana” rzetelnymi danymi ze sprawdzonego źródła. Można to porównać do sytuacji, w której asystent AI ma dostęp do firmowej wyszukiwarki lub bazy dokumentów i wykorzystuje ją, by udzielić precyzyjnej odpowiedzi zamiast zgadywać. W rezultacie odpowiedzi są bardziej wiarygodne i aktualne, a ryzyko dezinformacji maleje. Dla biznesu oznacza to, że chatboty, asystenci i inne rozwiązania AI mogą podejmować decyzje i udzielać informacji opartych na najnowszej wiedzy organizacji, budując zaufanie użytkowników.

Fundamenty poprawnie zbudowanej bazy RAG

Skuteczność systemu RAG w dużej mierze zależy od jakości i organizacji bazy wiedzy, z której model czerpie informacje. Poniżej opisuję kluczowe elementy, o które należy zadbać przy tworzeniu bazy RAG:

Czyszczenie i przygotowanie danych

Przed załadowaniem dokumentów do bazy RAG warto upewnić się, że dane są wysokiej jakości. Obowiązuje zasada “śmieci na wejściu, śmieci na wyjściu” – jeśli w bazie znajdą się zdublowane, nieaktualne lub błędne informacje, model może udzielać błędnych odpowiedzi. Dlatego należy usunąć duplikaty, poprawić oczywiste błędy, usunąć informacje zbędne oraz ujednolicić formatowanie (np. jednostki miar, nazwy). Dobrze jest także oznaczyć dane wstępnie tagami (np. temat, data) czy innymi etykietami – ułatwi to późniejsze wyszukiwanie. W skrócie, zbudujmy bazę z czystych, przejrzystych danych, bo to na nich oprze się cały system RAG.

Chunkowanie (dzielenie na fragmenty)

Następny fundament to chunkowanie, czyli podział dużych dokumentów na mniejsze, sensowne fragmenty. Dlaczego to ważne? Ponieważ modele AI mają ograniczenia co do ilości tekstu, który mogą naraz przetworzyć (kontekst). Długiego raportu (np. 50 stron) nie włożymy w całości do jednego promptu – zamiast tego dzielimy go na mniejsze części, np. akapity czy sekcje tematyczne, zwane “chunkami”. Każdy chunk powinien obejmować jedną spójną myśl lub temat, aby mógł zostać odnaleziony i zrozumiany niezależnie. Zbyt duże fragmenty mogą zawierać wiele niepowiązanych wątków (albo przekroczyć limit tokenów modelu), a zbyt małe – tracą kontekst i znaczenie. Dlatego często stosuje się sprytne strategie: np. dzielenie z nakładającymi się fragmentami (overlap), by zachować ciągłość kontekstu, lub podział semantyczny (rozdział według znaczenia, nie sztywnej liczby znaków). Poprawne chunkowanie zapewnia, że podczas wyszukiwania system znajdzie dokładnie ten kawałek informacji, którego potrzebuje, bez ucinania istotnych szczegółów.

Wektoryzacja i metadane

Każdy wyodrębniony fragment tekstu (chunk) należy następnie zamienić na wektor – czyli listę liczb reprezentującą znaczenie tego tekstu w przestrzeni semantycznej. Proces ten nazywa się tworzeniem embeddingu (osadzenia) i odbywa się za pomocą specjalnego modelu AI. Wektory umożliwiają porównywanie podobieństwa znaczeniowego – fragmenty o zbliżonej treści mają wektory leżące blisko siebie w tej przestrzeni. Wszystkie wektory wraz z odpowiadającymi im oryginalnymi fragmentami trafiają do bazy wektorowej (specjalnej bazy danych przystosowanej do wyszukiwania podobieństw). Popularne rozwiązania to np. postgres z rozszerzeniem pgvector (jak w Supabase), dedykowane silniki typu Pinecone czy wewnętrzne moduły wektorowe w narzędziach chmurowych.

Równolegle warto wzbogacić każdy fragment o metadane, czyli informacje opisujące kontekst: np. tytuł dokumentu, autora, datę publikacji, dział firmy, typ dokumentu (prezentacja, e-mail, raport) itp. Metadane pełnią rolę “znaczników”, po których można filtrować i sortować wyniki wyszukiwania. Ignorowanie metadanych to częsty błąd – sama podobieństwo tekstu nie zawsze wystarczy, by wybrać najlepszą odpowiedź. Dzięki metadanym system może np. priorytetyzować nowsze dokumenty nad starszymi, albo ograniczyć wyniki do konkretnego działu (np. tylko polityki HR). Dobrze zaprojektowana baza RAG pozwala przed wyszukiwaniem zastosować filtry (np. „pokaż tylko fragmenty dokumentów technicznych z ostatniego roku”) i tym samym znacząco poprawić trafność odpowiedzi.

Zarządzanie aktualnością (ciągłe aktualizacje)

Środowisko biznesowe jest dynamiczne – informacje szybko się dezaktualizują. Aktualność bazy wiedzy to zatem kolejny fundament RAG. Nawet najlepiej przygotowana wiedza traci wartość, jeśli nie odzwierciedla bieżącego stanu. Dlatego konieczne jest wdrożenie procesu ciągłego uzupełniania i czyszczenia bazy. Należy regularnie dodawać nowe dokumenty i dane, a przestarzałe informacje archiwizować lub usuwać. W praktyce firmy tworzą tzw. pipeline aktualizacyjny – np. harmonogram, który raz na tydzień lub przy każdej istotnej zmianie biznesowej automatycznie przetwarza świeże dane (nowe regulaminy, najnowsze procedury, nowe posty z firmowego intranetu) i umieszcza je w bazie RAG. Warto także oznaczać fragmenty znacznikami czasu (timestamp) i wykorzystywać je jako metadane – dzięki temu w czasie wyszukiwania można łatwo preferować najświeższe informacje. Krótko mówiąc, baza RAG musi żyć razem z firmą. Jeśli wiedza zmienia się, powinna od razu znaleźć odzwierciedlenie w wektorowej bazie; inaczej model może udzielać odpowiedzi opartych na nieaktualnych danych. Dbałość o aktualność bezpośrednio przekłada się na trafność i wiarygodność odpowiedzi systemu.

Narzędzia wspierające budowę systemu RAG

Wdrożenie RAG nie wymaga budowania wszystkiego od zera – istnieje wiele narzędzi i platform ułatwiających poszczególne etapy procesu. Oto kilka przykładów popularnych rozwiązań wykorzystywanych w praktyce:

- n8n – otwartoźródłowa platforma automatyzacji typu “workflow”, pozwalająca łączyć różne usługi bez kodowania. W kontekście RAG może posłużyć do zbudowania pipeline’u przetwarzania danych: np. automatycznie pobierać nowe pliki z wskazanego folderu, uruchamiać moduł ekstrakcji tekstu i dodawać wynik do bazy wektorowej. n8n umożliwia wizualne zaprojektowanie całego procesu – od ingestowania dokumentów, przez ich przetwarzanie, aż po wysyłanie zapytań do modelu AI. Dzięki integracjom z wieloma usługami (bazami danych, API modeli AI itp.) stanowi “klej” łączący wszystkie komponenty RAG.

- Supabase – nowoczesna baza danych w chmurze (PostgreSQL) z obsługą rozszerzenia pgvector. Pozwala w prosty sposób stworzyć własną bazę wektorową do przechowywania embeddingów. Supabase bywa często wybierany jako tani i wygodny zamiennik specjalistycznych wektorowych baz SaaS. Oferuje gotowe skrypty inicjujące tabelę wektorową (np. schema dostosowany do biblioteki LangChain) – po uruchomieniu otrzymujemy tabelę na dokumenty z kolumną wektorową o zadanej liczbie wymiarów. W kontekście RAG Supabase jest przykładem miejsca, gdzie trwale przechowujemy naszą bazę wiedzy (podczas gdy np. proste demo mogłoby trzymać wektory tylko w pamięci). Dzięki Supabase (lub podobnym rozwiązaniom jak Pinecone, Weaviate, Qdrant) mamy pewność, że wektory nie znikną po wyłączeniu aplikacji, a wyszukiwanie w nich będzie szybkie i skalowalne.

- Cohere – dostawca zaawansowanych modeli językowych, znany m.in. z wysokiej jakości modeli embedding oraz modelu rerankingu. W rozwiązaniach RAG Cohere może być użyty dwojako: po pierwsze do generowania wektorów (embedding) dla tekstu – ich model co.embed (i inne) potrafią zamieniać zdania na wektory w wielu wymiarach, podobnie jak modele OpenAI. Po drugie, Cohere udostępnia model ReRank (np. wersja 3.5), który służy do ponownego sortowania znalezionych dokumentów pod kątem ich przydatności dla danego pytania. W praktyce: po wstępnym wyszukaniu N potencjalnie pasujących fragmentów w bazie, można użyć modelu Cohere ReRank, by nadać im trafnościowe oceny i finalnie wybrać najlepsze np. 3-5, które faktycznie posłużą do zbudowania odpowiedzi. To dodatkowa warstwa zwiększająca precyzję wyników, szczególnie gdy mamy dużo podobnych dokumentów.

- Modele embedujące (embedding models) – to silniki stojące za konwersją tekstu na wektory. Poza wspomnianym Cohere, bardzo popularne są modele OpenAI (np.

text-embedding-ada-002), które zwracają 1536-wymiarowe wektory reprezentujące znaczenie tekstu. Istnieją też modele open-source (np. z biblioteki SentenceTransformers czy HuggingFace) trenowane do różnych domen (np. model SciBERT dla tekstów naukowych). Wybór właściwego modelu embedding jest istotny – powinien on rozumieć język i kontekst naszej domeny. Dla tekstów prawniczych inny model będzie optymalny, dla rozmów z klientami inny. Dobrze dobrany (lub wytrenowany) model wektorujący zapewni, że podobne znaczeniowo pytania i dokumenty rzeczywiście znajdą się blisko siebie w przestrzeni wektorowej, co przełoży się na skuteczność RAG. - ChatGPT, Claude, Grok i inne LLM – na końcu łańcucha RAG stoi generatywny model językowy, który z wykorzystaniem dostarczonego kontekstu formułuje końcową odpowiedź dla użytkownika. ChatGPT (od OpenAI) jest tu najbardziej znanym przykładem – można go poprzez API “zahookować” do własnego systemu, przekazując mu w promptcie znalezione wcześniej fragmenty wiedzy. Podobnie działa Claude (Anthropic) – model znany z dużego kontekstu i przyjaznego tonu, czy nowe modele open-source. Warto wspomnieć o modelu Grok od firmy xAI, który już z założenia jest systemem typu RAG: został zaprojektowany tak, by automatycznie pobierać na bieżąco informacje ze źródeł internetowych (np. z serwisu X/Twitter) i mieć dzięki temu najświeższą wiedzę. Każda z tych platform może pełnić rolę “mózgu” generującego odpowiedź, podczas gdy baza RAG jest jego “pamięcią zewnętrzną”. Wybór modelu LLM zależy od wymagań biznesowych – np. od tego, czy priorytetem jest styl odpowiedzi, długość kontekstu (Claude i Grok oferują bardzo obszerne konteksty), dostępność on-premise czy kwestie kosztowe.

Przykładowy pipeline RAG w firmie: od danych do odpowiedzi

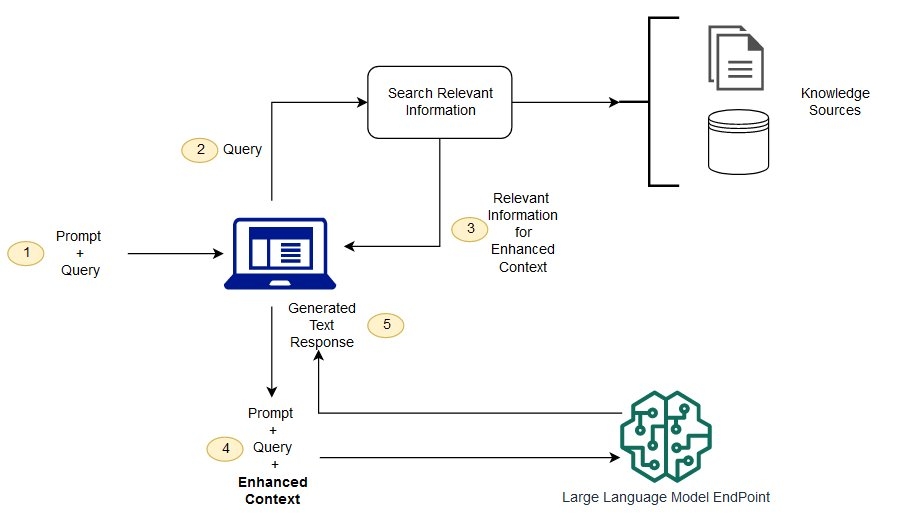

Mechanizm RAG może brzmieć skomplikowanie, ale prześledźmy krok po kroku, jak wygląda przetwarzanie pytania użytkownika z pomocą bazy RAG. Poniżej przedstawiamy uproszczony przykład pipeline’u RAG, który mógłby funkcjonować w firmowym środowisku:

Schemat procesu RAG (źródło: https://aws.amazon.com/what-is/retrieval-augmented-generation):

Na ilustracji pokazano przebieg działania systemu RAG. Użytkownik zadaje pytanie lub wpisuje prompt (lewa strona), następnie następuje faza retrieval – system wyszukuje pasujące informacje w bazie wiedzy (obejmująca m.in. procesy chunkowania, wektoryzacji i wyszukania semantycznego). Kolejno odbywa się contextualization – do pytania dołączany jest znaleziony kontekst (środkowy segment). Ostatecznie model generatywny tworzy odpowiedź, uwzględniając dostarczony kontekst (prawa strona schematu).

- Ingestowanie danych do bazy wiedzy: Na początku firma musi zasilić system danymi. Mogą to być dokumenty firmowe (PDFy, DOCXy), bazy FAQ, artykuły z bazy wiedzy, e-maile, a nawet wpisy z intranetu czy bazy ticketów. Dane te są zbierane i wprowadzane do systemu RAG. Przykładowo, integracja może automatycznie pobierać nowe pliki z określonego folderu lub regularnie skanować wskazaną witrynę w poszukiwaniu świeżych treści.

- Przetworzenie i indeksacja: Każdy pobrany dokument zostaje przetworzony: następuje czyszczenie (np. usunięcie boilerplate’u, tabel spisów treści itp.), podział na logiczne fragmenty (chunking), wygenerowanie wektorów dla tych fragmentów (embedding) oraz zapisanie ich w bazie wektorowej wraz z odpowiednimi metadanymi. Na tym etapie system tworzy swoją “pamięć” – powstaje indeks informacji, z którego będzie później korzystać. Jeśli dane są różnego typu, stosuje się dedykowane ekstraktory (np. użycie OCR dla skanowanych PDFów, aby wyciągnąć tekst. Ważne jest też, by unikać duplikacji – dobry pipeline rozpozna, czy dany dokument był już wcześniej zaindeksowany i ewentualnie zaktualizuje go zamiast dodawać ponownie, utrzymując bazę w czystośc.

- Analiza zapytania użytkownika: Gdy użytkownik (np. pracownik lub klient na czacie) zadaje pytanie w języku naturalnym, system RAG najpierw zamienia to pytanie na wektor (embedding zapytania) reprezentujący jego znaczenie. To tak, jakby pytanie zostało przełożone na “język matematyczny”, w którym łatwiej porównać je z zawartością bazy wiedzy.

- Wyszukanie kontekstu w bazie: Następnie następuje właściwe wyszukiwanie. Wektor zapytania jest porównywany z wektorami wszystkich dokumentów/fragmentów w bazie. Silnik wektorowy zwraca te fragmenty, których wektory są najbardziej zbliżone do zapytania – innymi słowy, są znaczeniowo najbardziej relewantne. Dodatkowo zastosowane mogą być filtry metadanych (np. tylko najnowsze informacje) oraz mechanizmy rankingowe, by spośród setek kandydatów wybrać garść najlepszych odpowiedzi. Załóżmy, że system wybiera 3 fragmenty tekstu, które łącznie zawierają odpowiedź na pytanie użytkownika.

- Kontekstualizacja i utworzenie promptu: Znalezione fragmenty (nazwijmy je kontekstem) zostają dołączone do oryginalnego pytania w specjalnie przygotowanym szablonie promptu. Taki prompt może np. brzmieć: “Udziel odpowiedzi na pytanie użytkownika na podstawie poniższych informacji: [tu wstawione są znalezione fragmenty z bazy]. Pytanie: [treść pytania]”. W ten sposób model generatywny otrzymuje nie tylko pytanie, ale i wszystkie dane potrzebne do udzielenia poprawnej odpowiedzi. Ten krok zapewnia, że model nie polega na swojej nieaktualnej pamięci, tylko na świeżo dostarczonym kontekście.

- Generacja odpowiedzi przez model: Teraz do akcji wkracza LLM (np. ChatGPT lub inny model). Przetwarza on przygotowany prompt z kontekstem i na tej podstawie generuje odpowiedź w języku naturalnym. Model stara się wpleść dostarczone informacje w swoją odpowiedź – dzięki temu odpowiedź jest konkretna, poprawna merytorycznie i odnosi się do firmowych danych (zamiast być ogólną zgadywanką).

- Dostarczenie odpowiedzi użytkownikowi: Ostatnim etapem jest zwrócenie odpowiedzi użytkownikowi, np. w interfejsie czatu lub aplikacji. Często odpowiedź taka może zawierać również odnośniki do źródeł (np. linki do dokumentów czy nazwę sekcji z której pochodzi informacja), co dodatkowo zwiększa zaufanie odbiorcy. Użytkownik widzi więc nie tylko wygenerowaną przez AI odpowiedź, ale ma pewność, z jakich danych ona wynika – może samodzielnie sprawdzić źródło, jeśli ma taką potrzebę. Cały proces od zapytania do odpowiedzi odbywa się zwykle w ułamku sekundy lub kilka sekund, w zależności od złożoności wyszukiwania i szybkości modelu generatywnego.

Korzyści biznesowe z dobrze zbudowanej bazy RAG

Jeśli system RAG jest poprawnie zaprojektowany i wdrożony, firma może czerpać z niego znaczące korzyści. Oto najważniejsze z nich i ich wpływ na jakość odpowiedzi AI:

- Większa dokładność i spójność odpowiedzi: model AI udziela odpowiedzi opartych na zweryfikowanej wiedzy firmowej, co minimalizuje ryzyko podania błędnych lub zmyślonych informacji. Udzielane odpowiedzi są merytorycznie zgodne ze stanem faktycznym, bo każdorazowo odwołują się do konkretnego fragmentu źródłowego. To buduje zaufanie użytkowników – zarówno klientów, jak i pracowników – do systemów AI.

- Aktualność i relevancja informacji: dzięki ciągłej aktualizacji bazy wiedzy system może udzielać odpowiedzi uwzględniających najnowsze dane (np. nowe regulacje, aktualne ceny, bieżące oferty). Unikamy problemu “przeterminowanej wiedzy”, na który cierpią zamknięte modele – RAG zapewnia dostęp do bieżących informacji w czasie rzeczywistym. Dla biznesu oznacza to decyzje podejmowane na aktualnych przesłankach i bardziej elastyczne reagowanie na zmiany.

- Oszczędność czasu i kosztów: podejście RAG jest znacznie tańsze niż trenowanie własnych modeli AI na firmowych danych. Zamiast kosztownej i długotrwałej procedury fine-tuningu modelu na każdym nowym zestawie informacji, wystarczy uzupełnić bazę wiedzy – model “nauczy się” nowych faktów natychmiast poprzez retrieval. To bardziej efektywne kosztowo i szybsze we wdrożeniu podejście. Ponadto pracownicy oszczędzają czas – odpowiedzi od AI przychodzą błyskawicznie, bez potrzeby ręcznego przekopywania się przez dokumenty.

- Personalizacja i precyzja domenowa: RAG umożliwia każdej organizacji włączenie do AI własnych, wewnętrznych zasobów wiedzy, które są unikalne dla jej działalności. W efekcie odpowiedzi mogą być dostosowane do specyfiki branży czy firmy – model przytoczy dokładnie te procedury, produkty czy regulacje, które obowiązują w danej organizacji. To przewaga nad standardowym AI, które opiera się tylko na wiedzy powszechnie dostępnej. Dzięki RAG, np. bank może mieć chatbot odpowiadający w oparciu o wewnętrzne polityki kredytowe, a dział HR zapewni pracownikom odpowiedzi zgodne z aktualnym regulaminem firmy.

- Zwiększone zaufanie i transparentność: dobrze zbudowany system RAG może prezentować użytkownikom źródła wykorzystanych informacji (np. cytaty, linki). Taka transparentność powoduje, że użytkownicy bardziej ufają odpowiedziom – widzą czarno na białym, skąd pochodzi dana informacja. W razie wątpliwości mogą sprawdzić kontekst w oryginalnym dokumencie. Dla firm oznacza to mniejsze ryzyko prawne i reputacyjne, bo każda informacja ma “podkładkę” w postaci źródła.

Podsumowując, Retrieval-Augmented Generation to podejście, które wnosi generatywne AI na wyższy poziom użyteczności w biznesie. Poprawnie zbudowana baza RAG – czysta, aktualna, dobrze zorganizowana – staje się fundamentem, na którym modele pokroju ChatGPT mogą budować rzetelne i kontekstowe odpowiedzi. Dla kadry zarządzającej i liderów technologicznych oznacza to możliwość wdrażania AI, która naprawdę wspiera pracowników i obsługę klienta, dostarczając sprawdzonych informacji w mgnieniu oka. W świecie, gdzie informacja jest paliwem decyzji, RAG umożliwia wykorzystanie pełnego potencjału danych firmowych przy zachowaniu kontroli nad wiedzą i jej jakością – a to przekłada się na lepsze decyzje, większą efektywność i przewagę konkurencyjną.